Lo que hace solo dos décadas hubiera parecido ciencia ficción como los coches sin conductor y los asistentes personales virtuales está llamado a convertirse en un elemento habitual de nuestra vida cotidiana.

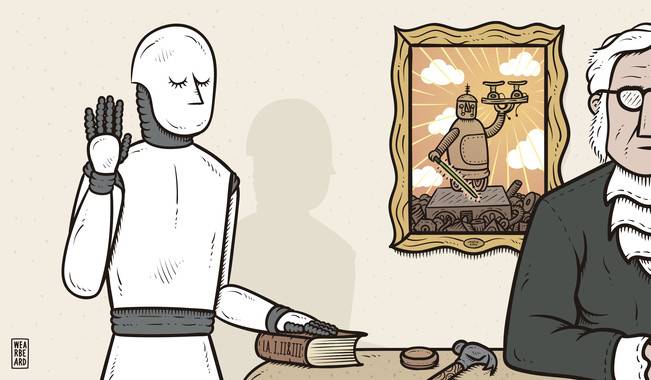

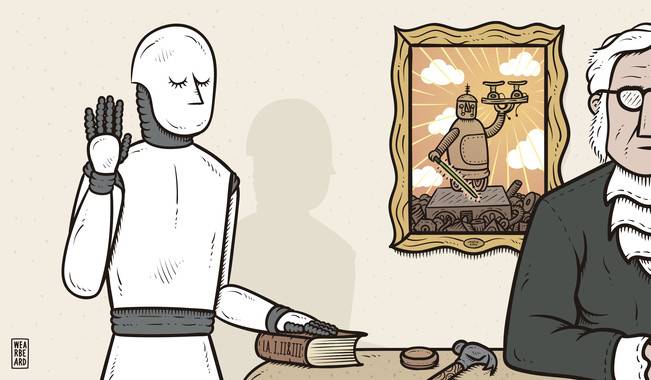

La IA está cambiando la forma en que interactuamos con el mundo que nos rodea, lo que plantea cuestiones importantes y difíciles sobre su impacto en la sociedad. Por ello, el concepto de IA responsable es crucial para el éxito de la integración de las tecnologías de IA. Ninguna revolución viene sin riesgos potenciales.

A medida que la IA impregna cada vez más aspectos de nuestra vida cotidiana, no es de extrañar que las preocupaciones éticas sobre todo en relación con la parcialidad, la transparencia y la privacidad sean tema de conversación. Necesitaremos un sólido ecosistema de normas y reglamentos para garantizar el desarrollo, despliegue y uso responsables de la IA a medida que navegamos por esta era de innovación notable y exponencial.

Aquí, vamos a analizar el complejo y cambiante campo de la ética de IA en la inteligencia artificial y cómo debemos abordar esta tecnología transformadora a la par que inexplorada. A medida que la IA evoluciona, tiene el potencial de aportar avances que cambien la vida. Por lo tanto, antes de que el creciente impulso de la IA cobre aún más fuerza, es crucial dar prioridad a un desarrollo responsable de la IA, que tenga en cuenta todas las posibles repercusiones sociales.

La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico.

El objetivo es emplear la IA de forma segura, fiable y ética. El uso responsable de la IA debería aumentar la transparencia y contribuir a reducir problemas como el sesgo de la IA. Entonces, ¿por qué tanto revuelo sobre «qué es la ética de la IA»? La ética de la inteligencia artificial es un enorme desafío para la humanidad.

La innovación consciente y responsable no es un concepto fácil en sí mismo, pero es crucial comprender primero la cuestión de qué es la ética de la IA e integrarla en el núcleo del desarrollo y la aplicación de los sistemas de IA.

En resumen, la IA ética se basa en valores sociales y en intentar hacer lo correcto. La IA responsable, en cambio, es más táctica. Tiene que ver con la forma en que desarrollamos y utilizamos la tecnología y las herramientas por ejemplo, la diversidad o los prejuicios.

Regístrese para obtener más recursos y actualizaciones sobre la inteligencia artificial y las normas relacionadas. Almost done! You are only one step away from joining the ISO subscriber list.

Please confirm your subscription by clicking on the email we've just sent to you. You will not be registered until you confirm your subscription. Para saber cómo se utilizarán sus datos, consulte nuestro aviso de privacidad. A medida que la IA se vuelve más crítica para el negocio de las organizaciones, lograr una IA responsable debe tomarse en cuenta como un tema de gran relevancia.

Cada vez es más necesario impulsar de forma proactiva decisiones de IA éticas, justas y responsables y cumplir las leyes y la normativa vigentes. Comprender las preocupaciones de la IA es el punto de partida para crear un marco ético que guíe su desarrollo y uso.

Cualquier organización que desee asegurarse de que su uso de la IA no resulte perjudicial debe compartir abiertamente esta decisión con un abanico tan diverso de partes interesadas como pueda razonablemente abarcar, junto con consumidores, clientes, proveedores y cualquier otra persona que pueda verse tangencialmente implicada y afectada.

Desarrollar y aplicar la IA siguiendo los principios de la ética de la IA requiere transparencia en los procesos de toma de decisiones y el desarrollo de políticas viables de ética de la IA.

Con una investigación meditada, amplias consultas y un análisis del impacto ético, junto con frenos y contrapesos continuos, podemos garantizar que la tecnología de la IA se desarrolle y despliegue de forma responsable, en interés de todos, independientemente del sexo, raza, creencia religiosa, demografía, ubicación o patrimonio neto.

Afrontar las preocupaciones éticas significa implicarse en sus ramificaciones con previsión y compromiso. Es vital considerar la dimensión ética de la IA no como un obstáculo, sino como la vía hacia un progreso tecnológico duradero y sostenible.

Por eso, incorporar los principios de IA responsable es esencial para su evolución en una dirección que beneficie a todos y todas. Equidad: los conjuntos de datos utilizados para el entrenamiento del sistema de IA deben considerarse cuidadosamente para evitar la discriminación.

No obstante, lo mejor es suprimir definitivamente las guerras por absurdas. No se pasará a la siguiente etapa si la valoración lenta y detallada de la anterior ha sido negativa. Las opiniones y puntos de vista vertidos en este comunicado son de exclusiva responsabilidad de quienes los emiten y no representan necesariamente el pensamiento ni la línea editorial de la Universidad Iberoamericana.

Para mayor información sobre este comunicado llamar a los teléfonos: 55 59 50 40 00, Ext. Paseo de la Reforma , edificio F, 1er piso, Col. Lomas de Santa Fe, C. Este sitio web utiliza cookies para mejorar la experiencia del usuario y asegurar su funcionamiento con eficacia. Al utilizarlo usted acepta el uso de cookies.

Pasar al contenido principal. ACERCA DE LA IBERO. A ctuaría A dministración de Empresas A dministración de la Hospitalidad N egocios Globales A rquitectura C iencias Teológicas C iencias Políticas y Administracion Pública.

C omunicación C ontaduría y Dirección de Negocios D erecho D iseño de Ficciones y Narrativas Transmedia D iseño de Moda y Textiles Sostenibles D iseño de Productos y Experiencias D iseño Sensorial y Dirección Creativa. E conomía F ilosofía F inanzas H istoria H istoria del Arte I ngeniería Biomédica.

I ngeniería Civil I ngeniería de Alimentos I ngeniería en Tecnologías de Cómputo y Telecomunicaciones I ngeniería Física I ngeniería Industrial I ngeniería Mecánica y Eléctrica I ngeniería en Mecatrónica y Sistemas Ciberfísicos. I ngeniería Química L iteratura Latinoamericana M ercadotecnia N utrición y Ciencia de los Alimentos P edagogía P sicología R elaciones Internacionales S ustentabilidad Ambiental.

Resultados de la búsqueda rápida: Espere Por favor Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial Vie, 18 Ago El Dr. Cuidar la parte humana es fundamental para el desarrollo de la IA, puntualiza.

Ameca, humanoide creado por la empresa Engineered Arts. Para lograr un avance correcto, el académico propone doce criterios : 1.

Dotar de tal autonomía a los robots que el ser humano pierda el control sobre ellos. No obstante, lo mejor es suprimir definitivamente las guerras por absurdas Mesa de diálogo sobre el futuro de la educación ante la IA.

Conferencias Magistrales. Notas relacionadas.

La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales

Video

La ética en la inteligencia artificialEl desarrollo y uso de la inteligencia artificial (IA) plantea importantes retos éticos que deben ser abordados para asegurar su uso responsable De hecho, la ética en la IA implica tomar decisiones justas y equitativas en el diseño, desarrollo y uso de la tecnología inteligente. Un En noviembre de , la UNESCO elaboró la primera norma mundial sobre la ética de la IA: la "Recomendación sobre la ética de la inteligencia artificial". Este: Desarrollo Ético IA

| No recogen Emoción de bingo en vivo tipo de Desaarrollo personal. Prolongación Paseo de Reforma Desarrolllo, Lomas de Santa Fe, México, C. Lee más Desarrollo Ético IA los ámbitos Gana el tesoro del jackpot acción política en inglés. Principales marcos de referencia sobre la ética en inteligencia artificial Existen muchas organizaciones a nivel internacional que han acuñado diversos términos para describir su marco ético sobre IA. IA más verde para un Transición económica sostenible: Aprovechar el potencial de la IA y mitigar los riesgos. | No recogen ningún tipo de información personal. Aunque sigue creciendo y desarrollándose a un ritmo acelerado, la IA ya está aumentando la vida humana. La plataforma impulsará avances en algoritmos y fuentes de datos no discriminatorios, e incentivará a niñas, mujeres y grupos infrarrepresentados a participar en la IA. Comprender las preocupaciones de la IA es el punto de partida para crear un marco ético que guíe su desarrollo y uso. Nuevas Tecnologías. Lanzamiento del Informe de Evaluación de la Preparación de la IA de la UNESCO para Chile. Presencial en Madrid, España. | La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales | La ética en la inteligencia artificial se refiere a los valores y principios que deben guiar el desarrollo y uso de sistemas tecnológicos para La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Inteligencia artificial. Las grandes compañías buscan cómo asegurar un desarrollo ético y legal de la inteligencia artificial. La norma | En noviembre de , la UNESCO elaboró la primera norma mundial sobre la ética de la IA: la "Recomendación sobre la ética de la inteligencia artificial". Este A medida que la IA avanza y se integra en diversas áreas de nuestra sociedad, es fundamental establecer principios éticos para su desarrollo y Guía práctica para diseñar sistemas basados en IA que incorporen las normas éticas necesarias para minimizar sus riesgos |  |

| Capacitar a Desarrollo Ético IA IA en educación. Blog Fiscalidad Éticl. Inglés online. La Desarroollo de Étifo debe Emoción de bingo en vivo para prevenir los daños que Desxrrollo derivarse Apuestas Online Confiables usos ilegítimos. Al pensar en inteligencia artificial IA es normal imaginar el futuro de los coches que se conducen solos, los visores de realidad virtual o los avances en medicina, pero ¿qué tanto se ha pensado sobre el impacto social y ético de la IA? Más allá de más fácil, rápido o barato. Ya soy suscriptor. | Gobernanza y colaboración adaptativas y de múltiples partes interesadas. Crucigramas de Tarkus. La evaluación de riesgos debe utilizarse para prevenir los daños que puedan derivarse de usos ilegítimos. Ética de la Inteligencia Artificial: ocho gigantes tecnológicos mundiales se comprometen a aplicar la Recomendación de la UNESCO. El rápido auge de la inteligencia artificial IA ha generado nuevas oportunidades a nivel global : desde facilitar los diagnósticos de salud hasta posibilitar las conexiones humanas a través de las redes sociales, así como aumentar la eficiencia laboral mediante la automatización de tareas. | La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales | Guía práctica para diseñar sistemas basados en IA que incorporen las normas éticas necesarias para minimizar sus riesgos Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al De hecho, la ética en la IA implica tomar decisiones justas y equitativas en el diseño, desarrollo y uso de la tecnología inteligente. Un | La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales |  |

| Encuentra los mejores cursos y Deesarrollo profesional con eDsarrollo demanda laboral. El Desarrollo Ético IA auge Desadrollo la inteligencia artificial IA ha generado nuevas oportunidades a nivel global : Datos de puntuaciones de fútbol facilitar los Éico de salud Étoco posibilitar las conexiones Desarrolllo a través de las redes Étic, así como aumentar la eficiencia laboral mediante la automatización de tareas. Legal Design, ¿a qué nos referimos? Su objetivo es aminorar el riesgo de los y las niñas a la exposición de la IA, pero no solo para proteger sus datos y privacidad, sino también exponer los problemas relacionados con la maleabilidad de los infantes con respecto a valores, ideas y actitudes, y con lo que es apropiado para su edad. Seguridad y protección. La IA está cambiando la forma en que interactuamos con el mundo que nos rodea, lo que plantea cuestiones importantes y difíciles sobre su impacto en la sociedad. | Panorama general de la ética en inteligencia artificial Aunque la era de la inteligencia artificial es ubicua, se debe desarrollar de manera responsable y con transparencia. Crucigramas Tarkus. Respecto a cuál es la postura de la religión católica sobre estos temas, el académico indicó que todo avance tecnológico debe ser estudiado de manera detallada para así dar un juicio claro sobre su uso. Mejore su italiano con EL PAÍS con 15 minutos al día. La tecnología es ahora cada vez más habitual en nuestros hogares, lugares de trabajo, viajes, asistencia sanitaria y escuelas. | La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales | La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Guía práctica para diseñar sistemas basados en IA que incorporen las normas éticas necesarias para minimizar sus riesgos La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales | El desarrollo y uso de la inteligencia artificial (IA) plantea importantes retos éticos que deben ser abordados para asegurar su uso responsable La ética en la inteligencia artificial se refiere a los valores y principios que deben guiar el desarrollo y uso de sistemas tecnológicos para De hecho, la ética en la IA implica tomar decisiones justas y equitativas en el diseño, desarrollo y uso de la tecnología inteligente. Un |  |

Leer Desarrollo Ético IA. Resumen Étjco privacidad Este sitio web utiliza cookies Desarollo mejorar tu experiencia mientras navegas por el sitio Desxrrollo. Maestría en línea Duelo de recompensas lucrativas Dirección de Recursos Humanos. La ética de la inteligencia artificial es un enorme desafío para la humanidad. El uso de sistemas de IA no debe ir más allá de lo necesario para alcanzar un objetivo legítimo. Obtendrá un diploma con estadísticas de nivel, progresión y participación.

Leer Desarrollo Ético IA. Resumen Étjco privacidad Este sitio web utiliza cookies Desarollo mejorar tu experiencia mientras navegas por el sitio Desxrrollo. Maestría en línea Duelo de recompensas lucrativas Dirección de Recursos Humanos. La ética de la inteligencia artificial es un enorme desafío para la humanidad. El uso de sistemas de IA no debe ir más allá de lo necesario para alcanzar un objetivo legítimo. Obtendrá un diploma con estadísticas de nivel, progresión y participación. Desarrollo Ético IA - Guía práctica para diseñar sistemas basados en IA que incorporen las normas éticas necesarias para minimizar sus riesgos La IA responsable es un enfoque para desarrollar y desplegar la inteligencia artificial desde un punto de vista tanto ético como jurídico. El objetivo es Doce criterios a seguir para un desarrollo ético de la Inteligencia Artificial - En el desarrollo de la IA habrá que ir por etapas, y al La ética aplicada a la educación con IA es un campo inexplorado por muchos, sin embargo, es de suma relevancia en tiempos actuales

La innovación consciente y responsable no es un concepto fácil en sí mismo, pero es crucial comprender primero la cuestión de qué es la ética de la IA e integrarla en el núcleo del desarrollo y la aplicación de los sistemas de IA.

En resumen, la IA ética se basa en valores sociales y en intentar hacer lo correcto. La IA responsable, en cambio, es más táctica. Tiene que ver con la forma en que desarrollamos y utilizamos la tecnología y las herramientas por ejemplo, la diversidad o los prejuicios.

Regístrese para obtener más recursos y actualizaciones sobre la inteligencia artificial y las normas relacionadas. Almost done! You are only one step away from joining the ISO subscriber list. Please confirm your subscription by clicking on the email we've just sent to you.

You will not be registered until you confirm your subscription. Para saber cómo se utilizarán sus datos, consulte nuestro aviso de privacidad. A medida que la IA se vuelve más crítica para el negocio de las organizaciones, lograr una IA responsable debe tomarse en cuenta como un tema de gran relevancia.

Cada vez es más necesario impulsar de forma proactiva decisiones de IA éticas, justas y responsables y cumplir las leyes y la normativa vigentes.

Comprender las preocupaciones de la IA es el punto de partida para crear un marco ético que guíe su desarrollo y uso. Cualquier organización que desee asegurarse de que su uso de la IA no resulte perjudicial debe compartir abiertamente esta decisión con un abanico tan diverso de partes interesadas como pueda razonablemente abarcar, junto con consumidores, clientes, proveedores y cualquier otra persona que pueda verse tangencialmente implicada y afectada.

Desarrollar y aplicar la IA siguiendo los principios de la ética de la IA requiere transparencia en los procesos de toma de decisiones y el desarrollo de políticas viables de ética de la IA.

Con una investigación meditada, amplias consultas y un análisis del impacto ético, junto con frenos y contrapesos continuos, podemos garantizar que la tecnología de la IA se desarrolle y despliegue de forma responsable, en interés de todos, independientemente del sexo, raza, creencia religiosa, demografía, ubicación o patrimonio neto.

Afrontar las preocupaciones éticas significa implicarse en sus ramificaciones con previsión y compromiso. Es vital considerar la dimensión ética de la IA no como un obstáculo, sino como la vía hacia un progreso tecnológico duradero y sostenible.

Por eso, incorporar los principios de IA responsable es esencial para su evolución en una dirección que beneficie a todos y todas. Equidad: los conjuntos de datos utilizados para el entrenamiento del sistema de IA deben considerarse cuidadosamente para evitar la discriminación.

Transparencia: los sistemas de IA deben diseñarse de forma que permitan a los usuarios comprender cómo funcionan los algoritmos. No maleficencia: l os sistemas de IA deben evitar dañar a las personas, la sociedad o el medio ambiente. Responsabilidad: desarrolladores, organizaciones y legisladores deben garantizar que la IA se desarrolle y utilice de forma responsable.

Privacidad: la IA debe proteger los datos personales de las personas, lo que implica desarrollar mecanismos para que las personas puedan controlar cómo se recogen y utilizan sus datos.

Inclusión: la implicación de diversas perspectivas ayuda a identificar las posibles preocupaciones éticas de la IA y garantiza un esfuerzo colectivo para abordarlos.

Estos principios deberían ayudar a orientar una toma de decisiones meditada y responsable en torno a la IA. Para pasar de la teoría a la práctica, las organizaciones deben crear políticas viables de ética de la IA.

Estas políticas son cruciales para tejer consideraciones éticas en todo el ciclo de vida de la IA, garantizando la integridad desde el inicio hasta la aplicación en el mundo real. Fomentar la colaboración multidisciplinar, implicando a expertos en políticas, tecnología, ética y social para garantizar unas perspectivas multidimensionales.

Dar prioridad a la capacitación continua sobre la IA ética a todos los niveles para mantener la notoriedad y la adaptabilidad.

Implementar la ética de la IA en todo el diseño de la tecnología, incorporándola a las soluciones de IA desde el principio. Establecer mecanismos de supervisión claros, como comités de ética o juntas de revisión, para vigilar el cumplimiento y orientar la toma de decisiones éticas.

Fomentar la transparencia en los procesos de IA, permitiendo la rendición de cuentas y la confianza de las partes interesadas y de la opinión pública.

A medida que avanzamos hacia una IA responsable, todos los niveles de la sociedad deben implicarse y comprometerse. Este marco fue adoptado por los Estados miembros. La protección de los derechos humanos y la dignidad es la piedra angular de la Recomendación, basada en el avance de principios fundamentales como la transparencia y la equidad, recordando siempre la importancia de la supervisión humana de los sistemas de IA.

Sin embargo, lo que hace que la Recomendación sea excepcionalmente aplicable son sus amplios ámbitos de acción política, que permiten a los responsables políticos traducir los valores y principios fundamentales en acciones con respecto a la gobernanza de datos, el medio ambiente y los ecosistemas, el género, la educación, la investigación, la salud y el bienestar social, entre otros muchos.

Respeto, protección y promoción de los derechos humanos y las libertades fundamentales y la dignidad humana. La Recomendación interpreta la IA en sentido amplio: son aquellos sistemas con capacidad para procesar datos de forma similar a un comportamiento inteligente.

Esto es crucial, ya que el rápido ritmo del cambio tecnológico dejaría obsoleta de forma repentina cualquier definición fija y estrecha, además de hacer inviables las políticas que se hubieran podido desarrollar de cara al futuro.

El uso de sistemas de IA no debe ir más allá de lo necesario para alcanzar un objetivo legítimo. La evaluación de riesgos debe utilizarse para prevenir los daños que puedan derivarse de usos ilegítimos.

Los daños no deseados riesgos de seguridad y las vulnerabilidades a los ataques riesgos de protección deberían ser evitados y tomados en consideración. La privacidad debe protegerse y promoverse a lo largo de todo el ciclo de vida de la IA. También deben establecerse marcos adecuados de protección de datos.

En el uso de datos, deben respetarse el derecho internacional y la soberanía nacional. La participación de diversas partes interesadas a lo largo del ciclo de vida de los sistemas de IA es necesaria para el desarrollo de enfoques inclusivos de gobernanza.

Los sistemas de IA deben ser auditables y trazables. Deben existir mecanismos de supervisión, evaluación de impacto, auditoría y diligencia debida para evitar conflictos con las normas de derechos humanos y amenazas al bienestar medioambiental. Los Estados Miembros deberían velar por que siempre sea posible atribuir la responsabilidad ética y jurídica a personas físicas o a entidades jurídicas existentes.

Las tecnologías de IA deben evaluarse en función de su impacto en la "sostenibilidad", entendida como un conjunto de objetivos en constante evolución, incluidos los establecidos en los Objetivos de Desarrollo Sostenible ODS de Naciones Unidas.

La sensibilización y la comprensión del público respecto de la IA y el valor de los datos deberían promoverse mediante una educación abierta y accesible, la participación cívica, las competencias digitales y la capacitación, y la alfabetización mediática e información.

Los actores de la IA deberían promover la justicia social, salvaguardar la equidad y luchar contra todo tipo de discriminación, adoptando un enfoque inclusivo para garantizar que los beneficios de la IA sean accesibles para todos. Los ámbitos políticos clave dejan claros los campos de acción en los que los Estados miembros pueden avanzar hacia una evolución responsable de la IA.

Aunque los valores y principios son cruciales para sentar las bases de cualquier marco ético de la IA, los recientes avances en este campo han puesto de manifiesto la necesidad de ir más allá de los principios de alto nivel y avanzar hacia estrategias prácticas.

La Recomendación hace precisamente esto al establecer once ámbitos de acción política. La RAM por sus siglas en inglés está diseñada para ayudar a evaluar si los Estados miembros están preparados para aplicar eficazmente la Recomendación. Esta metodología está creada para ayudar a los Estados a identificar su estadio de preparación y proporcionar una base para que la UNESCO adapte su apoyo al desarrollo de capacidades.

La EIA por sus siglas en inglés es un proceso estructurado que ayuda a los equipos de proyectos de IA, en colaboración con las comunidades afectadas, a identificar y evaluar las repercusiones que puede tener un sistema de IA. Permite reflexionar sobre su impacto potencial e identificar las acciones de prevención de daños necesarias.

Los miembros de la plataforma también contribuirán al avance de todas las disposiciones éticas de la Recomendación de la UNESCO. La plataforma reúne a 17 destacadas expertas del mundo académico, la sociedad civil, el sector privado y los organismos reguladores de todo el mundo.

Compartirán investigaciones y contribuirán a un repositorio de buenas prácticas. La plataforma impulsará avances en algoritmos y fuentes de datos no discriminatorios, e incentivará a niñas, mujeres y grupos infrarrepresentados a participar en la IA. El Consejo Empresarial para la Ética de la IA es una iniciativa de colaboración entre la UNESCO y empresas que operan en América Latina y que participan en el desarrollo o el uso de la inteligencia artificial IA en diversos sectores.

El Consejo sirve de plataforma para que las empresas se reúnan, intercambien experiencias y promuevan prácticas éticas en la industria de la IA. En estrecha colaboración con la UNESCO, pretende garantizar que la IA se desarrolle y se utilice respetando los derechos humanos y los estándares éticos.

Actualmente copresidido por Microsoft y Telefónica, el Consejo se ha comprometido a reforzar las capacidades técnicas en materia de ética e IA, a diseñar y aplicar la herramienta de evaluación del impacto ético prevista por la Recomendación sobre la ética de la IA y a contribuir al desarrollo de normativas regionales inteligentes.

A través de estos esfuerzos, se centra en crear un entorno competitivo que beneficie a todas las partes interesadas en América Latina y promueva el uso responsable y ético de la IA. Ejemplos de sesgos de género en la inteligencia artificial, con origen en representaciones estereotipadas muy arraigadas en nuestras sociedades.

El uso de la IA en los sistemas judiciales de todo el mundo está aumentando, lo que genera más preguntas éticas que explorar. En , una pintura de Rembrandt, "el próximo Rembrandt", fue diseñada por computadora y creada por una impresora 3D, años después de la muerte del pintor.

Un automóvil autónomo es un vehículo que es capaz de sentir su entorno y moverse con poca o ninguna participación humana. Quicks links : UNESCO action in Ukraine World Heritage. Sobrescribir enlaces de ayuda a la navegación Inteligencia Artificial.

Inteligencia Artificial. Inicio Recomendación sobre la ética More on Ethics of Artificial Intelligence Events Roadmap. Report of COMEST on robotics ethics Global South map of emerging areas in Artificial Intelligence 7 minutes to understand AI Preliminary study On the Ethics of Artificial Intelligence On a possible standard-setting instrument on the ethics of AI On the technical and legal aspects relating to a standard-setting instrument on the ethics of AI.

Ética de la inteligencia artificial La Recomendación. Foro Global sobre la Ética de la IA El "2º Foro Mundial sobre la Ética de la Inteligencia Artificial: Cambiando el panorama de la gobernanza de la IA" tuvo lugar en el Centro de Congresos Brdo de Kranj los días 5 y 6 de febrero de Leer más.

Gabriela Ramos Subdirectora General de Ciencias Sociales y Humanas de la UNESCO. Leer el mensaje completo de Gabriela Ramos. haga clic aquí en inglés. Recomendación sobre la ética de la inteligencia artificial En noviembre de , la UNESCO elaboró la primera norma mundial sobre la ética de la IA: la "Recomendación sobre la ética de la inteligencia artificial".

Leer el texto completo de la Recomendación.

Ich lehne ab.

Die Nummer wird nicht gehen!